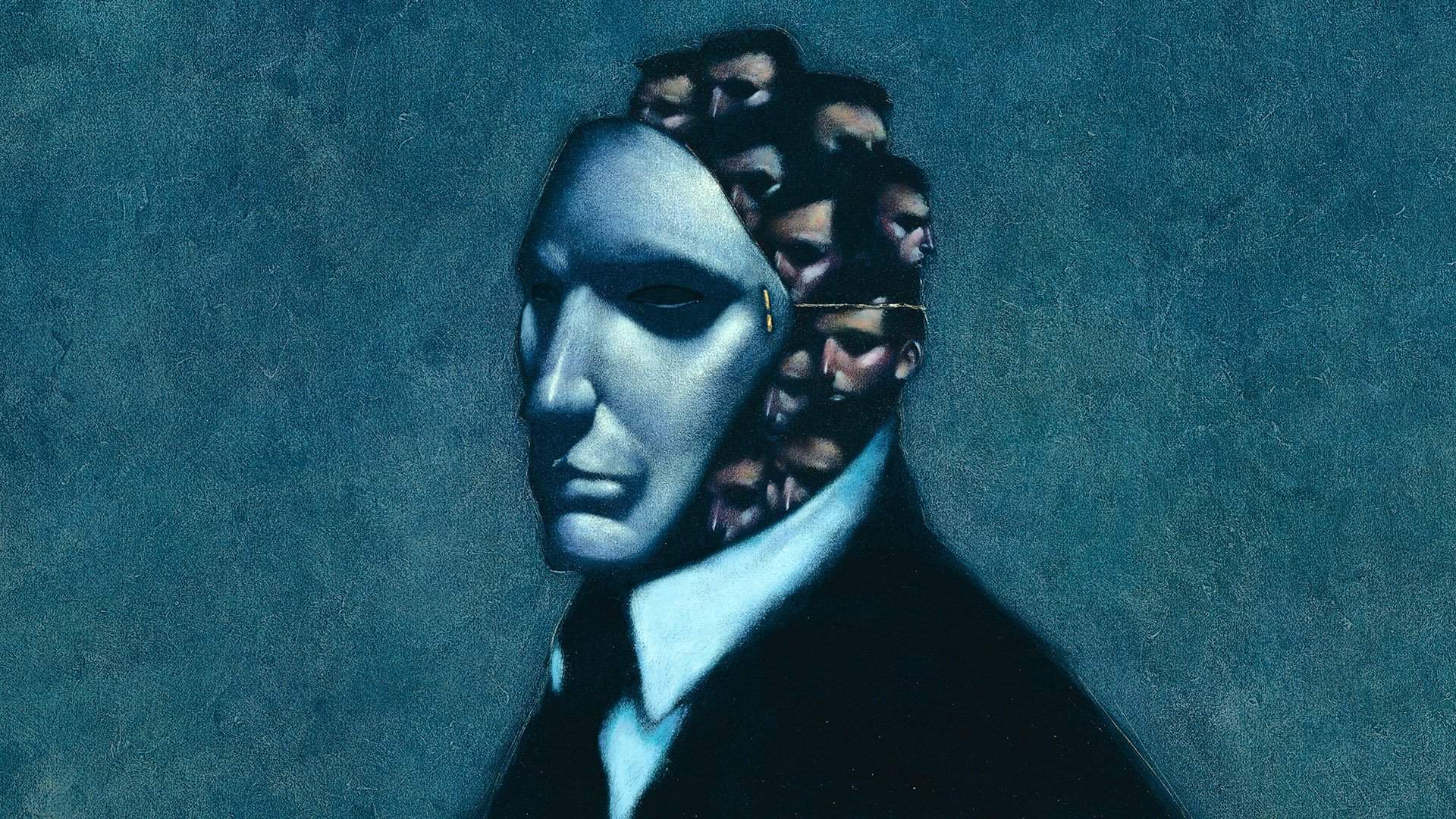

Шоу Трумана – 2019: как нейросети научили фальсифицировать новостную картину

Чтобы создать для любого из нас «индивидуальную» новостную картину и фальсифицировать подобранные в ней сообщения СМИ, сегодня достаточно усилий одного программиста. Об этом «Известиям» рассказали специалисты по искусственному интеллекту и кибербезопасности. Совсем недавно, по их оценкам, для этого требовалась работа нескольких команд. Подобное ускорение стало возможным с развитием технологий атак на нейросети и генерации звуковых и видеофальшивок с помощью программ для создания «глубоких фейков» (deepfake). Подобной атаке недавно подверглась газета «Известия», когда сразу три ливийских новостных портала опубликовали сообщение, якобы вышедшее в одном из номеров. По словам специалистов, в течение 3–5 лет можно ожидать нашествия ботов-манипуляторов, которые автоматически смогут создавать множество фейков.

Дивный новый мир

Проектов, которые подстраивают информационную картину под восприятие конкретных пользователей, в последнее время появляется всё больше. Одним из примеров их работы стала недавняя акция трех ливийских порталов, которые опубликовали новость, якобы напечатанную в номере «Известий» от 20 ноября. Создатели фейка видоизменили первую полосу газеты, разместив на ней сообщение о переговорах фельдмаршала Халифы Хафтара и премьера правительства национального согласия (ПНС) Файеза Сарраджа. Фальшивку, выполненную шрифтом «Известий», сопровождало фото двух лидеров, сделанное в мае 2017 года. Плашка с логотипом издания была вырезана из реально вышедшего в печать номера от 20 ноября, а все остальные тексты на полосе из выпуска от 23 октября.

С точки зрения специалистов, в обозримом будущем такие фальсификации можно будет делать в автоматическом режиме.

— Технологии искусственного интеллекта сегодня полностью открыты, а устройства для получения и обработки данных миниатюризируются и дешевеют, — сообщил «Известиям» доктор физико-математических наук, профессор РАН, начальник подразделения ФГУП «ГосНИИАС» Юрий Вильзитер. — Поэтому велика вероятность, что в скором будущем подслушивать и подсматривать за нами, а также манипулировать реальностью смогут даже не государство и крупные корпорации, а просто частные лица. В течение ближайших лет появится возможность, анализируя предпочтения пользователя, воздействовать на него посредством подборок новостей и очень искусных фейков.

По мнению Юрия Вильзитера, технологии, которые могут быть задействованы для подобного вмешательства в ментальную среду, существуют уже сейчас. Теоретически нашествия ботов-манипуляторов можно ожидать уже через несколько лет, отметил он. Сдерживающим моментом здесь может стать необходимость сбора больших баз примеров реакций реальных людей на искусственные стимулы с отслеживанием долгосрочных последствий. Такое отслеживание, вероятно, потребует еще несколько лет исследований до получения стабильных результатов таргетированных атак.

Атака на зрение

С Юрием Вильзитером согласен и руководитель отдела аналитики компании «СёрчИнформ» Алексей Парфентьев. По его словам, специалисты уже прогнозируют атаки на нейросети, хотя сейчас подобных примеров практически нет.

— Исследователи из Gartner считают, что к 2022 году 30% всех кибератак будут нацелены на порчу данных, на которых тренируется нейросеть, и кражу готовых моделей машинного обучения. Тогда, например, беспилотные автомобили неожиданно могут начать принимать пешеходов за другие объекты. И речь будет идти не о финансовом или репутационном риске, а о жизни и здоровье простых людей, — считает эксперт.

Атаки на системы компьютерного зрения осуществляются в рамках исследований уже сейчас. Цель таких атак — заставить нейросеть обнаружить на изображении то, чего там нет. Или, наоборот, не увидеть того, что планировалось.

— Одна из активно развивающихся тем в сфере обучения нейронных сетей — так называемые adversarial-атаки («состязательные атаки». — «Известия»), — пояснил веб-аналитик «Лаборатории Касперского» Владислав Тушканов. — В большинстве случаев они направлены на системы компьютерного зрения. Для проведения такой атаки в большинстве случаев требуется иметь полный доступ к нейросети (так называемые white-box-атаки) или результатам ее работы (black-box-атаки). Методов, которые позволяют обмануть любую систему компьютерного зрения в 100% случаев, не существует. Кроме того, уже созданы инструменты, которые позволяют тестировать нейросети на устойчивость к adversarial-атакам и повышать их устойчивость.

В ходе такой атаки злоумышленник пытается каким-то образом изменить распознаваемое изображение так, чтобы нейросеть не сработала. Часто на фото накладывается шум, схожий с тем, который возникает при фотографировании в плохо освещаемом помещении. Человек обычно плохо замечает такие помехи, а вот нейросеть начинает сбоить. Но для того чтобы провернуть такую атаку, злоумышленнику нужен доступ к алгоритму.

По словам генерального директора компании «Нейросети Ашманова» Станислава Ашманова, на данный момент методов борьбы с этой проблемой не существует. Кроме того, эта технология доступна любому желающему: программист средней квалификации может ею воспользоваться, скачав необходимое открытое программное обеспечение с сервиса Github.

— Атака на нейросети — это методика и алгоритмы обмана нейронной сети, которые заставляют ее выдавать ложные результаты, а по сути, взламывают ее, как дверной замок, — считает Ашманов. — Например, сейчас довольно легко можно заставить систему распознавания лиц думать, что перед ней не вы, а Арнольд Шварценеггер — это делается путем подмешивания незаметных человеческому глазу добавок в данные, поступающие к нейросети. Такие же атаки возможны и для систем распознавания и анализа речи.

Эксперт уверен, что дальше будет только хуже — эти технологии пошли в массы, мошенники уже сейчас их используют, а средств защиты от них нет. Как нет защиты и от автоматизированного создания подделок видео и аудио.

Глубокие фейки

Технологии deepfake, основанные на Deep Learning (технологии глубокого обучения нейросетей. — «Известия»), уже сейчас представляют реальную угрозу. Видео- или аудиофальшивки создаются с помощью монтажа или наложения лиц известных людей, которые якобы произносят необходимый текст и играют нужную роль в сюжете.

— Deepfake позволяет заменить движения губ и речь человека на видео, что создает ощущение реалистичности происходящего, — рассказывает директор департамента инновационной защиты бренда и интеллектуальной собственности Group-IB Андрей Бусаргин. — Фейковые знаменитости «предлагают» в социальных сетях пользователям поучаствовать в розыгрыше ценных призов (смартфонов, автомобилей, денежных сумм) и т.д. Ссылки из таких видеопубликаций часто ведут на мошеннические и фишинговые сайты, где пользователей просят ввести личные данные, включая данные банковских карт. Подобные схемы представляют собой угрозу как для обычных пользователей, так и для публичных лиц, которые упоминаются в рекламных роликах. Из-за махинаций такого рода образы знаменитостей начинают ассоциироваться с мошенничеством или рекламируемыми товарами, и здесь мы сталкиваемся с ущербом личному бренду, — говорит он.

Еще одна угроза связана с использованием «фейковых голосов» для телефонного мошенничества. Например, в Германии злоумышленники использовали голосовой deepfake, чтобы в телефонном разговоре, выдавая себя за руководителя компании, заставить руководителя дочерней фирмы из Великобритании срочно перевести €220 тыс. на счет некоего венгерского поставщика. Глава британской фирмы заподозрил подвох, когда его «босс» попросил о втором денежном переводе, но звонок при этом исходил с австрийского номера. К этому моменту первый транш уже поступил на счет в Венгрии, откуда деньги были выведены в Мексику.

Получается, что ныне существующие технологии позволяют создать индивидуальную новостную картину, наполненную фейковыми новостями. Причем отличить подделки от реального видео и аудио скоро можно будет только аппаратными средствами. По словам специалистов, меры, запрещающие развитие нейросетей, вряд ли будут эффективными. Поэтому скоро мы будем жить в мире, в котором нужно будет постоянно всё перепроверять.

— К этому нужно готовиться, и это нужно принять, — подчеркнул Юрий Вильзитер. — Человечество не впервые переходит из одной реальности в другую. Наш мир, способ жизни и ценности радикально отличаются от мира, в котором жили наши предки 60 000 лет назад, 5000 лет назад, 2000 лет назад и даже 200–100 лет назад. Человек в скором будущем в значительной степени будет лишен приватности и потому принужден ничего не скрывать и поступать честно. В то же время ничего в окружающей реальности и собственной личности нельзя будет принимать на веру, всё придется подвергать сомнению и постоянно перепроверять. Но будет ли эта будущая реальность ужасной? Нет. Она просто будет совершенно иной.